٢٦ أبريل ٢٠٢٦

© بوابة الذكاء الاصطناعي

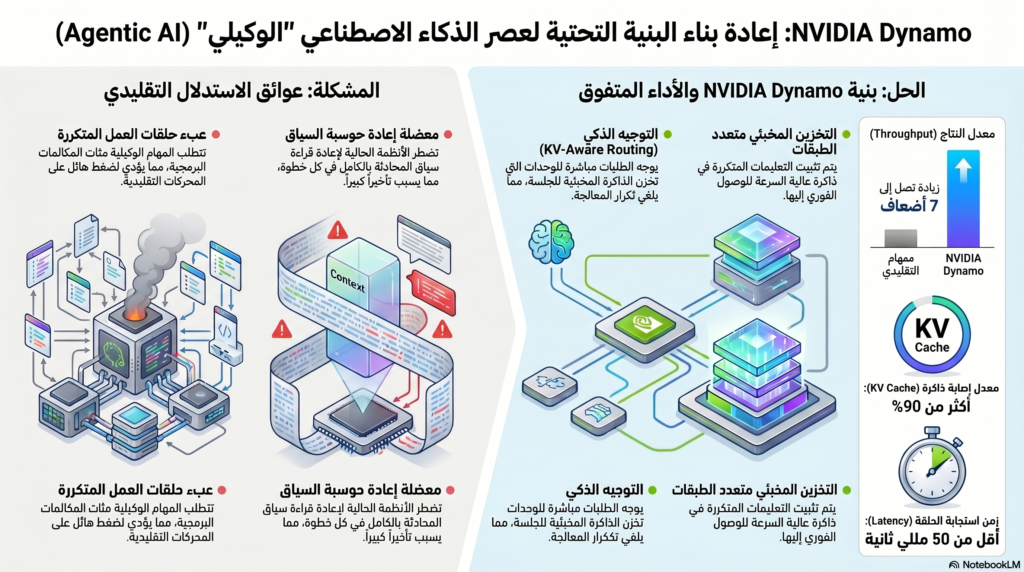

لقد تغيرت معايير الذكاء الاصطناعي رسميًا. لم نعد نبني روبوتات محادثة بسيطة تعتمد على إدخال النص وإخراجه. نحن نصمم وكلاء مستقلين ينفذون عمليات معقدة متعددة الخطوات. لكن الاستدلال التقليدي ينهار تحت وطأة هذه الحلقات. هنا يأتي دور NVIDIA Dynamo.

نظرة سريعة

| 🏢 المطور | NVIDIA |

| ⚙️ البنية الأساسية | محرك تنظيم الاستدلال الأول للوكيل (Agent-First) |

| 🎯 الأفضل لـ | مهندسو أنظمة الذكاء الاصطناعي، مهندسو MLOps، أطر العمل متعددة الوكلاء (LangGraph، AutoGen) |

| 🚀 الأداء الرئيسي | زيادة الإنتاجية حتى ٧ مرات وزمن استجابة منخفض للغاية |

عنق الزجاجة في الذكاء الاصطناعي الوكيل

يكشف بناء الأنظمة المستقلة عن خلل هيكلي كبير في عمليات نشر نماذج اللغة الكبيرة (LLM) الحالية: لم يتم بناء الاستدلال التقليدي للبرمجة الوكيلة.

عندما يجيب روبوت محادثة قياسي على استفسار، فإنه يقوم بإجراء مكالمة API واحدة. ومع ذلك، عندما تعمل أداة وكيلة – مثل تحليل واجهة مستخدم سطح المكتب، وكتابة الكود، وتنفيذه، وقراءة سجلات الأخطاء، وإعادة كتابته – فإنها تقوم بإجراء مئات المكالمات في كل جلسة. في كل مرة يعود فيها الوكيل لتقييم حالة الشاشة أو التحقق من الكود، يجب على محركات الاستدلال التقليدية إعادة حساب السياق التاريخي بالكامل. هذا التكرار يخلق اختناقات حسابية شديدة، مما يزيد من زمن الاستجابة وتكاليف الأجهزة إلى مستويات غير مستدامة.

الأركان الأربعة لـ NVIDIA Dynamo

أدركت NVIDIA هذا الانهيار الهيكلي بالضبط وأعادت بناء مجموعة الاستدلال من الألف إلى الياء. لتحقيق الحلقات المستقلة عالية السرعة، تستبدل Dynamo معالجة الاستدلال القياسية ببنية تحتية “أولية للوكيل” تعتمد على أربعة أركان أساسية:

- التوجيه المدرك لـ KV: في إعدادات Kubernetes التقليدية، يتم توزيع الطلبات بشكل عشوائي على عمال GPU المتاحين، مما يجبر العامل الجديد على إعادة قراءة نافذة السياق بالكامل. تقوم Dynamo بتوجيه استعلام الوكيل بذكاء إلى عامل GPU المحدد الذي يحتفظ بالفعل بذاكرة التخزين المؤقت (KV Cache) لتلك الجلسة بالذات. هذا يلغي المعالجة الزائدة.

- الجدولة المدركة للوكيل: تفهم Dynamo تسلسل الحلقات الوكيلة. بدلاً من التعامل مع كل مكالمة API كحدث معزول، تقوم بجدولة المهام بناءً على أولوية وحالة الوكيل النشطة، مما يمنع التأخيرات المكلفة في تبديل السياق.

- التخزين المؤقت متعدد المستويات: لم يعد التخزين المؤقت مجرد ذاكرة مؤقتة بسيطة؛ إنه تسلسل هرمي عميق. تقوم Dynamo بتثبيت السياق الأساسي بشكل دائم مباشرة في ذاكرة التخزين المؤقت عالية السرعة. يتم استرجاع التعليمات النظامية المتكررة على الفور بدلاً من إعادة حسابها.

- التنظيم الموحد: يتم دمج إدارة عقد GPU، التخزين المؤقت الموزع، والتوجيه في طبقة تنظيم واحدة، مما يبسط بشكل كبير نشر الأنظمة متعددة الوكلاء عبر مراكز البيانات.

ما يعنيه هذا للهياكل الإنتاجية

إذا كنت فريقًا هندسيًا ينظم أنظمة معقدة، مثل استخدام LangGraph للتحكم في سطح المكتب بشكل مستقل، أو نشر AutoGen لأسطول من وكلاء البرمجة، فإن العبء الحسابي لإعادة تقييم حالة النظام في كل خطوة هو حاجزك الرئيسي للتنفيذ في الوقت الفعلي.

من خلال استبدال البنية التحتية القديمة بمجموعة NVIDIA Dynamo، يختبر المطورون تحولًا كاملاً في مقاييس الأداء:

الحكم النهائي

NVIDIA Dynamo ليست مجرد تحديث آخر لمحرك الاستدلال؛ إنها البنية التحتية الأساسية المطلوبة لثورة الذكاء الاصطناعي الوكيل. من خلال حل مشكلة تجزئة ذاكرة التخزين المؤقت وتقديم الجدولة المدركة للوكيل، قامت NVIDIA بإزالة الاحتكاك المادي الذي كان يعيق الأطر متعددة الوكلاء في الوقت الفعلي.

✅ الإيجابيات

- يحل اختناقات إعادة حساب السياق بشكل جذري.

- زيادة ضخمة في الإنتاجية بمقدار ٧ مرات للوكلاء المتكررين.

- التوجيه المدرك لـ KV يحسن استخدام GPU فورًا.

- تكامل مثالي مع بيئات LangGraph و AutoGen.

❌ السلبيات

- موجه بشكل صارم نحو MLOps المؤسسية؛ مبالغ فيه للتطبيقات البسيطة.

- يتطلب إعادة هيكلة البنية التحتية الحالية للاستفادة الكاملة منه.

- اعتماد كلي وشديد على بيئة الأجهزة الخاصة بـ NVIDIA.